- Таобао

- Книги / Журналы/ Газеты

- Общественные науки

- Социология

- 569106822766

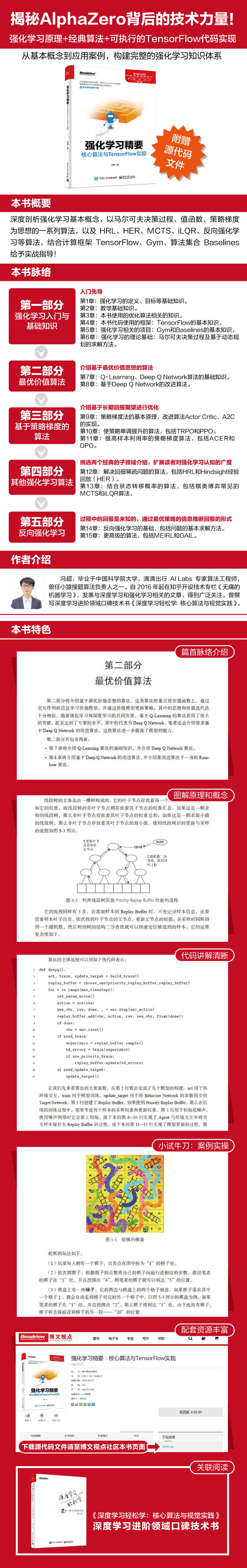

Подкрепление учебной эссенции и Tensorflow для реализации компьютерного и интернет -алгоритма Feng Chao и применения.

Вес товара: ~0.7 кг. Указан усредненный вес, который может отличаться от фактического. Не включен в цену, оплачивается при получении.

Описание товара

- Информация о товаре

- Фотографии

|

Оглавление

Первая часть укрепляет вход в обучение и базовые знания

1 Введение 2

1.1 Концепция укрепления обучения

1.1.1 собака Баполова

1.1.2 русская площадь

1.2 Стоя с точки зрения экспериментов, чтобы увидеть проблему

1.3 Оценка укрепления последствий обучения

1.3.1 Держите пробную версию и ошибку

1.3.2 Акцент на длительную прибыль

1.4 Укрепление обучения и наблюдения

1.4.1 Укрепление сущности обучения и надзора и обучения

1.4.2 Имитационное обучение

1.5 Экспериментальная среда для укрепления обучения

1.5.1 Arcade Learning Environment 12

1.5.2 Box2D 12

1.5.3 MuJoCo 13

1.5.4 Gym 14

1.6 Основное содержание этой книги

1.7 Справочные материалы

2 Фонд математики и машинного обучения 17

2.1 Линейная алгебра

2.2 природа симметричной матрицы

2.2.1 Значения функций и векторы функций

2.2.2 Особенности и функции векторов симметричной матрицы

2.2.3 Диалог симметричной матрицы

2.3 Теория вероятности

2.3.1 Вероятность и распределение

2.3.2 Оценка максимальной вероятности

2.4 Выборка

2.5 Теория информации

2,6 кл рассеянный

2.7 Выпуклые функции и природа

2.8 Основная концепция машинного обучения

2.9 Целевая функция машинного обучения

2.10 Сводка

3 Алгоритм оптимизации 47

3.1 Метод падения

3.1.1 Что такое метод падения градиента

3.1.2 Элегантные шаги

3.2 Алгоритм импульса

3.3 Метод градиента корпорации

3.3.1 изысканные ограничения

3.3.2 вместе 0,00

3.3.3 Оптимизируйте определение размера шага

3.3.4 Метод грамма-смидта

3.3.5 Градин

3.4 Природный метод градиента

3.4.1 Основная концепция

3.4.2 Информационная матрица Фишера

3.4.3 Целевая формула естественного градиента

3.5 Резюме

4 TensorFlow Начало работы 78

4.1 Основное использование Tensorflow

4.2 Принципы Tensorflow Введение

4.2.1 Создайте область 83 переменной

4.2.2 Создайте историю за переменной

4.2.3 Операция

4.2.4 tf.gradients 96

4.2.5 Optimizer 102

4.2.6 Навыки обратного общения Tensorflow

4.2.7 use_scope Использование

4.3 Распределенное обучение Tensorflow

4.3.1 Параллельная модель данных на основе MPI

4.3.2 Реализация MPI: MPI_ADAM 121

4.4 Реализуйте классическую сетевую структуру на основе Tensorflow

4.4.1 Многоветное восприятие

4.4.2 Служба нейронная сеть

4.4.3 Круглая нейронная сеть

4.5 Резюме

4.6 Справочные материалы

5 тренажерный зал и базовый линии 130

5.1 Gym 130

5.1.1 Установка спортзала

5.1.2 Основное использование спортзала

5.1.3 Используйте тренажерный зал для достижения классической шахматной игры: Snake Chess

5.2 Baselines 138

5.2.1 Python 3 Особенности в базовых показателях

5.2.2 tf_util 141

5.2.3 Расширение платформы спортзала

5.3 Резюме

6 Укрепление обучения базовому алгоритму 145

6.1 Марковский процесс принятия решения

6.1.1 MDP: стратегия и модель окружающей среды

6.1.2 Функция значения и формула Bellman

6.1.3&Ldquo;”Agent 151

6.2 Стратегия итерация

6.2.1 Стратегический итерационный метод

6.2.2 Доказательство улучшения стратегии

6.2.3 Эффект итерации стратегии

6.3 Итерация

6.3.1 и раунд стратегии итерации

6.3.2 Разговор об итерации ценности с точки зрения динамического планирования

6.3.3 Реализация итерации стоимости

6.4 Обобщение итерации

6.4.1 Два крайности

6.4.2 Метод итерации стратегии

6.4.3 Реализация итерации обобщения

6.5 Сводка

Вторая часть алгоритма оптимального значения

7 Q-обучение базового 173

7.1 Вероятность передачи статуса: от захвата до оставления

7.2 Монте -Карло Метод

7.3 Исследуйте и используйте

7.4 Проблема дисперсии Монте Карло

7.5 разница в синхронизации и сарса 183

7.6 Q-Learning 186

7.7 Анализ конвергенции Q-обучения

7.8 от формы к модели значения

7.9 Deep Q Network 195

7.10 Резюме

7.11 Справочные материалы

8 -DQN Алгоритм улучшения 203

8.1 Double Q-Learning 203

8.2 Priority Replay Buffer 204

8.3 Dueling DQN 209

8.4 Решите холодный начало DQN

8.5 Distributional DQN 214

8.5.1 Распределение выходных значений

8.5.2 Обновленное распределение

8.6 Noisy Network 218

8.7 Rainbow 221

8.7.1 Модель Rainbow

8.7.2 Реализация сети Deep Q.

8.8 Резюме

8.9 Справочные материалы

Третья часть основана на алгоритме стратегического градиента

9 Алгоритм на основе стратегического градиента 229

9.1 Стратегический метод градиента

9.1.1 Алгоритм

9.1.2 Анализ алгоритма

9.1.3 Улучшение алгоритма

9.2 Актер-критический алгоритм

9.2.1 Уменьшите дисперсию алгоритма

9.2.2 Алгоритм A3C

9.2.3 Алгоритм A2C Фактический бой

9.3 Резюме

9.4 Справочные материалы

10 Оптимизированный алгоритм 244 для улучшения стратегии монотонного улучшения 244

10.1 TRPO 244

10.1.1 Разрыв стратегии

10.1.2 Объективная формула для стратегического продвижения

10.1.3 Целевое определение TRPO

10.1.4 Решение метода естественного градиента

10.1.5 Реализация TRPO

10.2 GAE 256

10.2.1 Определение формулы GAE

10.2.2 Оптимизация функции значения на основе GAE и TRPO

10.2.3 Реализация GAE

10.3 PPO 261

10.3.1 PPO введение

10.3.2 ППО Алгоритм Практика

10.4 Резюме

10.5 Справочные материалы

11 Метод градиента стратегии вне политики 265

11.1 Retrace 266

11.1.1 Основная концепция повреждения

11.1.2 Алгоритм реализация повреждения

11.2 ACER 270

11.2.1 Off-Policy Actor-Critic 270

11.2.2 Acer Algorithm

11.2.3 Реализация ACER

11.3 DPG 279

11.3.1 Оптимизация стратегии непрерывного пространства

11.3.2 Последовательность параметров стратегической модели

11.3.3 Алгоритм DDPG

11.3.4 Реализация DDPG

11.4 Резюме

11.5 Справочные материалы

Часть 4 другие улучшенные алгоритмы обучения

12 Решение метод редко вознаграждения 291

12.1 Сложность редких возвратов

12.2 -Улучшенное обучение

12.3 HER 298

12.3.1 Гравитация

12.3.2 Ее реализация

12.4 Резюме

12.5 Справочные материалы

13 Метод на основе модели 305

13.1 AlphaZero 305

13.1.1 Go Game

13.1.2 Альфа-бета-дерево

13.1.3 MCTS 309

13.1.4 Стратегическая модель

13.1.5 Модельная дуэль

13.2 iLQR 316

13.2.1 Решение линейной модели

13.2.2 Решение нелинейных моделей

13.2.3 Реализация ILQR

13.3 Резюме

13.4 Справочные материалы

Пятая часть обучения обратного подкрепления

14 Обратное подкрепление учебное поступление 330

14.1 Основная концепция

14.2 Награда от оптимальной стратегии

14.2.1 Решите целевую функцию возврата

14.2.2 Ограничения целевой функции

14.3 В поисках линейного планирования

14.3.1 Решение линейного планирования

14.3.2 Фактический случай

14.4 Решение в бесконечном состоянии

14.5 Учитесь из образца

14.6 Резюме

14.7 Справочные материалы

15 Алгоритм обучения обратному подкреплению 2.0 345

15.1 максимальная энтропийная модель

15.1.1 Индексная семья

15.1.2 Разработка модели максимальной энтропии

15.1.3 Реализация модели максимальной энтропии

15.2 Максимальное энтропия Обучение

15.3 GAIL 361

15.3.1 Основная концепция Ган

15.3.2 Анализ обучения Ган

15.4 Реализация Гейл

15.5 Резюме

15.6 Справочные материалы

Читатели могут учиться на базовом процессе принятия решений Маркова к различным сложным улучшенным алгоритмам обучения.В дополнение к введению принципов этих алгоритмов, эта книга также глубоко анализирует внутреннюю связь между алгоритмами, которая может помочь читателям сдаться и овладеть сущностью алгоритма.Код, представленный в книге, может помочь читателям быстро применить алгоритм для практики.

С 2016 года он открыл техническую колонку «Безболезненное машинное обучение» и опубликовал статьи, связанные с глубоким обучением и укреплением обучения.Письмо в области продвинутого обучения в области глубокого обучения «Легкое обучение глубокому обучению: основной алгоритм и визуальная практика».

Практикующие и исследователи искусственного интеллекта.Читатели с глубоким обучением и укреплением обучающих фондов.