- Таобао

- Книги / Журналы/ Газеты

- 667295319520

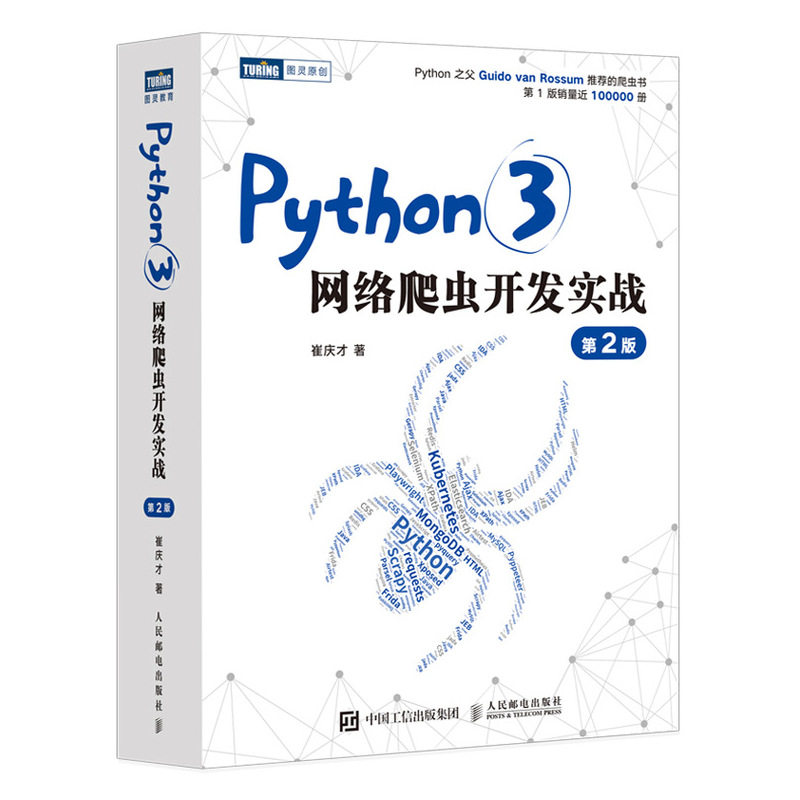

Python3 Интернет -разработка аварийная разработка фактическая борьба 2 -й издание

Цена: 1 458руб. (¥69)

Артикул: 667295319520

Вес товара: ~0.7 кг. Указан усредненный вес, который может отличаться от фактического. Не включен в цену, оплачивается при получении.

Описание товараPHA+PGltZyBzcmM9Imh0dHA6Ly9pbWcuYWxpY2RuLmNvbS9pbWdleHRyYS9pNC8yMjA5MDcwMzcyMDMxL08xQ04wMTZKUVFXUjFRc0Y3MGlyMHdTXyEhMjIwOTA3MDM3MjAzMS0xLXNjbWl0ZW02MDAwLmdpZiIgYWxpZ249ImFic21pZGRsZSI+PC9wPjxwPiZuYnNwOzwvcD48ZGl2PjxkaXY+0J7RgdC90L7QstC90LDRjyDQuNC90YTQvtGA0LzQsNGG0LjRjzwvZGl2PjxkaXY+PHRhYmxlIHdpZHRoPSI3MDAiIGJvcmRlcj0iMCIgY2VsbHNwYWNpbmc9IjEwIiBjZWxscGFkZGluZz0iNSI+PHRib2R5Pjx0cj48dGQgd2lkdGg9IjgyIj48c3Ryb25nPtC90LDQuNC80LXQvdC+0LLQsNC90LjQtSDRgtC+0LLQsNGA0LA6PC9zdHJvbmc+PC90ZD48dGQgd2lkdGg9IjI3NyI+UHl0aG9uMyBOZXR3b3JrIENyYXdsZXIgRGV2ZWxvcG1lbnQgRmFjdGlvbiBCaWdodCDihJYgMiDQuNC30LTQsNC90LjQtSZuYnNwOyA8L3RkPjx0ZCB3aWR0aD0iODIiPjxzdHJvbmc+0YTQvtGA0LzQsNGCOjwvc3Ryb25nPjwvdGQ+PHRkIHdpZHRoPSIxNjkiPjE2PC90ZD48L3RyPjx0cj48dGQ+PHN0cm9uZz7QkNCy0YLQvtGAOjwvc3Ryb25nPjwvdGQ+PHRkPkN1aSBRaW5nY2FpPC90ZD48dGQ+PHN0cm9uZz7QmtC+0LvQuNGH0LXRgdGC0LLQviDRgdGC0YDQsNC90LjRhjo8L3N0cm9uZz48L3RkPjx0ZD4gJm5ic3A7IDwvdGQ+PC90cj48dHI+PHRkPjxzdHJvbmc+0KbQtdC90Ys6PC9zdHJvbmc+PC90ZD48dGQ+IDEzOS44PC90ZD48dGQ+PHN0cm9uZz7QntC/0YPQsdC70LjQutC+0LLQsNC90L3QsNGPINC00LDRgtCwOjwvc3Ryb25nPjwvdGQ+PHRkPiAyMDIxLTExLTAxPC90ZD48L3RyPjx0cj48dGQ+PHN0cm9uZz7QndC+0LzQtdGAIElTQk46PC9zdHJvbmc+PC90ZD48dGQ+IDk3ODcxMTU1NzcwOTI8L3RkPjx0ZD48c3Ryb25nPtCS0YDQtdC80Y8g0L/QtdGH0LDRgtC4Ojwvc3Ryb25nPjwvdGQ+PHRkPiAyMDIxLTExLTAxPC90ZD48L3RyPjx0cj48dGQ+PHN0cm9uZz7QmNC30LTQsNGC0LXQu9GM0YHRgtCy0L46PC9zdHJvbmc+PC90ZD48dGQ+0J3QsNGA0L7QtNC90YvQtSDRgdC+0L7QsdGJ0LXQvdC40Y8g0Lgg0YLQtdC70LXQutC+0LzQvNGD0L3QuNC60LDRhtC40Lg8L3RkPjx0ZD48c3Ryb25nPtCS0LXRgNGB0LjRjzo8L3N0cm9uZz48L3RkPjx0ZD4gMjwvdGQ+PC90cj48dHI+PHRkPjxzdHJvbmc+0KLQuNC/0Ysg0L/RgNC+0LTRg9C60YLQsDo8L3N0cm9uZz48L3RkPjx0ZD7QutC90LjQs9C4PC90ZD48dGQ+PHN0cm9uZz7QmNC90LTQuNC50YHQutC40Lk6PC9zdHJvbmc+PC90ZD48dGQ+IDI8L3RkPjwvdHI+PC90Ym9keT48L3RhYmxlPjwvZGl2PjwvZGl2PjxwPjxpbWcgY2xhc3M9ImRlc2NfYW5jaG9yIiBpZD0iZGVzYy1tb2R1bGUtMiIgc3JjPSJodHRwOi8vYXNzZXRzLmFsaWNkbi5jb20va2lzc3kvMS4wLjAvYnVpbGQvaW1nbGF6eWxvYWQvc3BhY2ViYWxsLmdpZiI+PC9wPjxkaXY+PGRpdj7QntCxINCw0LLRgtC+0YDQtTo8L2Rpdj48ZGl2PkN1aSBRaW5nY2FpIC0g0LjQvdC20LXQvdC10YAgLdC/0YDQvtCz0YDQsNC80LzQuNGB0YIg0LIgTWljcm9zb2Z0IChDaGluYSksINGB0YLQtdC/0LXQvdGMINC80LDQs9C40YHRgtGA0LAg0LIg0J/QtdC60LjQvdGB0LrQvtC8INGD0L3QuNCy0LXRgNGB0LjRgtC10YLQtSDQsNGN0YDQvtC90LDQstGC0LjQutC4INC4INCw0YHRgtGA0L7QvdCw0LLRgtC40LrQuCwg0LIg0L7RgdC90L7QstC90L7QvCDQuNC30YPRh9Cw0Y8g0LLQtdCxIC3RgdC60LDQvdC10YDQvtCyLCDQstC10LEgLdGA0LDQt9GA0LDQsdC+0YLQutGDLCDQvNCw0YjQuNC90L3QvtC1INC+0LHRg9GH0LXQvdC40LUg0Lgg0LTRgNGD0LPQuNC1INC90LDQv9GA0LDQstC70LXQvdC40Y8uPC9kaXY+PC9kaXY+PGltZyBjbGFzcz0iZGVzY19hbmNob3IiIGlkPSJkZXNjLW1vZHVsZS0zIiBzcmM9Imh0dHA6Ly9hc3NldHMuYWxpY2RuLmNvbS9raXNzeS8xLjAuMC9idWlsZC9pbWdsYXp5bG9hZC9zcGFjZWJhbGwuZ2lmIj48ZGl2PjxkaXY+0JrRgNCw0YLQutC+0LUg0YHQvtC00LXRgNC20LDQvdC40LU6PC9kaXY+PGRpdj7QkiDRjdGC0L7QuSDQutC90LjQs9C1INC+0L/QuNGB0YvQstCw0LXRgtGB0Y8sINC60LDQuiDRgNCw0LfRgNCw0LHQvtGC0LDRgtGMINCy0LXQsSAt0YHQutCw0L3QtdGA0Ysg0YEg0L/QvtC80L7RidGM0Y4gUHl0aG9uIDMuINCt0YLQsCDQutC90LjQs9CwINGP0LLQu9GP0LXRgtGB0Y8g0LLRgtC+0YDRi9C8INC40LfQtNCw0L3QuNC10Lwu0J/QviDRgdGA0LDQstC90LXQvdC40Y4g0YEg0L/QtdGA0LLRi9C8INC40LfQtNCw0L3QuNC10LwsINC+0L0g0L7RgdC90LDRidC10L0g0YbQtdC70LXQvdCw0L/RgNCw0LLQu9C10L3QvdGL0LzQuCDRg9GH0LXQsdC90YvQvNC4INGB0YLQsNC90YbQuNGP0LzQuCDQtNC70Y8g0L/RgNCw0LrRgtC40YfQtdGB0LrQuNGFINC/0YDQvtC10LrRgtC+0LIg0LrQsNC20LTQvtC5INGC0L7Rh9C60Lgg0LfQvdCw0L3QuNGPLCDQuNC30LHQtdCz0LDRjyDQv9GA0L7QsdC70LXQvNGLINC40YHRgtC10YfQtdC90LjRjyDRgdGA0L7QutCwINC00LXQudGB0YLQstC40Y8u0JrRgNC+0LzQtSDRgtC+0LPQviwg0LfQvdCw0L3QuNGPLCDRgtCw0LrQuNC1INC60LDQuiDQsNGB0LjQvdGF0YDQvtC90L3Ri9C1INGB0LrQsNC90LXRgNGLLCBKYXZhU2NyaXB0IFJldmVyc2UsIEFwcCBSZXZlcnNlLCDQuNC90YLQtdC70LvQtdC60YLRg9Cw0LvRjNC90YvQuSDQsNC90LDQu9C40Lcg0YHRgtGA0LDQvdC40YYsINC60L7QtCDQv9GA0L7QstC10YDQutC4INGA0LDRgdC/0L7Qt9C90LDQstCw0L3QuNGPINCz0LvRg9Cx0L7QutC+0LPQviDQvtCx0YPRh9C10L3QuNGPLCDQsdGL0LvQuCDQtNC+0LHQsNCy0LvQtdC90Ysg0Y3QutGB0L/Qu9GD0LDRgtCw0YbQuNGPINC4INGC0LXRhdC90LjRh9C10YHQutC+0LUg0L7QsdGB0LvRg9C20LjQstCw0L3QuNC1INC4INGA0LDQt9Cy0LXRgNGC0YvQstCw0L3QuNC1IEt1YmVybmV0ZXMu0JIg0YLQviDQttC1INCy0YDQtdC80Y8sINGC0LDQutC40LUg0LjQvdGB0YLRgNGD0LzQtdC90YLRiywg0LrQsNC6INC30LDQv9GA0L7RgSwg0YXRgNCw0L3QtdC90LjQtSwg0LDQvdCw0LvQuNC3INC4INGC0LXRgdGC0LjRgNC+0LLQsNC90LjQtSwg0YHQstGP0LfQsNC90L3Ri9C1INGBINC60LDQttC00L7QuSDRgtC+0YfQutC+0Lkg0LfQvdCw0L3QuNC5LCDQsdGL0LvQuCDQvtCx0L7Qs9Cw0YnQtdC90Ysg0Lgg0L3QvtCy0YvQvNC4Ljxicj4gJm5ic3A7Jm5ic3A7Jm5ic3A7Jm5ic3A70K3RgtCwINC60L3QuNCz0LAg0L/QvtC00YXQvtC00LjRgiDQtNC70Y8g0L/RgNC+0LPRgNCw0LzQvNC40YHRgtC+0LIgUHl0aG9uINC00LvRjyDRh9GC0LXQvdC40Y8uPHA+Li4uLi4uPC9wPjwvZGl2PjwvZGl2PjxpbWcgY2xhc3M9ImRlc2NfYW5jaG9yIiBpZD0iZGVzYy1tb2R1bGUtNCIgc3JjPSJodHRwOi8vYXNzZXRzLmFsaWNkbi5jb20va2lzc3kvMS4wLjAvYnVpbGQvaW1nbGF6eWxvYWQvc3BhY2ViYWxsLmdpZiI+PGRpdj48ZGl2PtCe0LPQu9Cw0LLQu9C10L3QuNC1OjwvZGl2PjxkaXY+0JPQu9Cw0LLQsCAxINCe0YHQvdC+0LLRiyDQs9GD0YHQtdC90LjRhtGLIDE8YnI+MS4xIGh0dHAgQmFzaWMgUHJpbmNpcGxlIDE8YnI+MS4yINCe0YHQvdC+0LLRiyDQstC10LEgLdGB0YLRgNCw0L3QuNGG0YsgMTI8YnI+MS4zINCe0YHQvdC+0LLQvdGL0LUg0L/RgNC40L3RhtC40L/RiyBDcmF3bGVycyAxOTxicj4xLDQg0YHQtdCw0L3RgdCwINC4INC60YPQutC4IDIxPGJyPjEuNSDQntGB0L3QvtCy0L3Ri9C1INC/0YDQuNC90YbQuNC/0Ysg0LDQs9C10L3RgtCwIDI0PGJyPjEuNiDQntGB0L3QvtCy0L3Ri9C1INC/0YDQuNC90YbQuNC/0Ysg0LzQvdC+0LPQvtC/0L7RgtC+0YfQvdC+0LPQviDQuCDQvNC90L7Qs9C+0L/RgNC+0YbQtdGB0YHQsCAyNjxicj7Qk9C70LDQstCwIDIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0LHQsNC30L7QstC+0Lkg0LHQuNCx0LvQuNC+0YLQtdC60LggMjk8YnI+Mi4xINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IFVybGxpYiAyOTxicj4yLjIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0LfQsNC/0YDQvtGB0L7QsiA0Nzxicj4yLjMg0KDQtdCz0YPQu9GP0YDQvdC+0LUg0LLRi9GA0LDQttC10L3QuNC1IDYzPGJyPjIuNCDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSBIVFRQWCA3Mzxicj4yLjUg0J7RgdC90L7QstC90LDRjyDQv9GA0LDQutGC0LjQutCwINC60L7RgNC/0YPRgdCwIENyYXdsZXIgNzg8YnI+0JPQu9Cw0LLQsCAzINCQ0L3QsNC70LjQtyDQuCDQuNC30LLQu9C10YfQtdC90LjQtSDQtNCw0L3QvdGL0YUg0LLQtdCxIC3RgdGC0YDQsNC90LjRhtGLIDkwPGJyPjMuMSB4cGF0aCDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSA5MDxicj4zLjIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0LrRgNCw0YHQuNCy0L7Qs9C+INGB0YPQv9CwIDk5PGJyPjMuMyDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSBQeXF1ZXJ5IDExMzxicj4zLjQg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0J/QsNGA0YHQtdC70Y8gMTI0PGJyPtCT0LvQsNCy0LAgNCDQpdGA0LDQvdC10L3QuNC1INC00LDQvdC90YvRhSAxMjg8YnI+NC4xIFRYVCBUZXh0IEZpbGUgU3RvcmFnZSAxMjg8YnI+NC4yIEpTT04gRmlsZSBTdG9yYWdlIDEzMDxicj40LjMgQ1NWIEZpbGUgU3RvcmFnZSAxMzQ8YnI+NC40IE15U1FMIFN0b3JhZ2UgMTM4PGJyPjQuNSDRhdGA0LDQvdC40LvQuNGJ0LUg0LTQvtC60YPQvNC10L3RgtC+0LIgTW9uZ29EQiAxNDQ8YnI+NC42IFJlZGlzIENhY2hlIFN0b3JhZ2UgMTUxPGJyPjQuNyBFbGFzdGljc2VhcmNoIFNlYXJjaCBFbmdpbmUgU3RvcmFnZSAxNTk8YnI+NC44INCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IFJhYmJpdG1xIDE2Njxicj7Qk9C70LDQstCwIDUgQWpheCBEYXRhIENsYXdsaW5nIDE3NDxicj41LjEg0KfRgtC+INGC0LDQutC+0LUgQWpheCAxNzQ8YnI+NS4yINCc0LXRgtC+0LQg0LDQvdCw0LvQuNC30LAgQUpBWCAxNzY8YnI+NS4zIEFqYXggQW5hbHlzaXMgYW5kIENsYXdsaW5nIFByYWN0aWNlIDE3OTxicj7Qk9C70LDQstCwIDYg0JDRgdC40L3RhdGA0L7QvdC90YvQuSDQs9GD0YHQtdC90LjRhtCwIDE5MTxicj42LjEg0J7RgdC90L7QstC90YvQtSDQv9GA0LjQvdGG0LjQv9GLIENvcm91dGluZXMgMTkxPGJyPjYuMiDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSBBSU9IVFRQIDIwMTxicj42LjMgQUlPSFRUUCDQkNGB0LjQvdGF0YDQvtC90L3QsNGPINC/0YDQsNC60YLQuNC60LAg0L/QvtC70LfQsNC90LjRjyAyMDc8YnI+0JPQu9Cw0LLQsCA3INCh0YLRgNCw0L3QuNGG0LAg0LTQuNC90LDQvNC40YfQtdGB0LrQvtCz0L4g0YDQtdC90LTQtdGA0LjQvdCz0LAgSmF2YVNjcmlwdCAyMTI8YnI+Ny4xINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INGB0LXQu9C10L3QsCAyMTI8YnI+Ny4yINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IFNwbGFzaCAyMjY8YnI+Ny4zINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IFB5cHBldGVlciAyNDI8YnI+Ny40INCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INC00YDQsNC80LDRgtGD0YDQs9CwIDI1Nzxicj43LjUgU2VsZW5pdW0gUHJhY3RpY2tpbmcgMjY5PGJyPjcuNiBQeXBwZXRlZXIgQ2xhd2xpbmcgUHJhY3RpY2UgMjc2PGJyPjcuNyBDU1MgUG9zaXRpb24gT2Zmc2V0IEFudGktQ2xpbWJpbmcgQ2FzZSBBbmFseXNpcyDQuCBQcmFjdGljZSAyODI8YnI+Ny44INCQ0J3QkNCb0JjQlyDQkNCd0KLQmC3QmtCb0JjQnNCh0JjQndCT0J7QktCe0JPQniDQkNCd0JDQm9CY0JfQkCDQmCDQn9Cg0JDQmtCi0JjQp9CV0KHQmtCY0Jkg0JrQm9CQ0JfQntCS0KvQmSDQoNCQ0KHQn9Cg0JDQktCb0JXQndCY0JUgMjg3PGJyPtCT0LvQsNCy0LAgOCDQmNC00LXQvdGC0LjRhNC40LrQsNGG0LjRjyDQutC+0LTQsCDQv9GA0L7QstC10YDQutC4IDI5Mzxicj44LjEuINCe0L/RgNC10LTQtdC70LjRgtC1INCz0YDQsNGE0LjRh9C10YHQutC40LUg0LrQvtC00Ysg0L/RgNC+0LLQtdGA0LrQuCDRgSDQuNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtdC8INGC0LXRhdC90L7Qu9C+0LPQuNC4IE9DUiAyOTM8YnI+OC4yINCY0YHQv9C+0LvRjNC30YPQudGC0LUgT3BlbkNWLCDRh9GC0L7QsdGLINC+0L/RgNC10LTQtdC70LjRgtGMINC/0YDQvtCx0LXQu9GLINCyINC60L7QtNCw0YUg0YHQutC+0LvRjNC20LXQvdC40Y8uIDI5ODxicj44LjMuINCe0L/RgNC10LTQtdC70LjRgtC1INC60L7QtNGLINC/0YDQvtCy0LXRgNC60Lgg0LPRgNCw0YTQuNC60LAsINC40YHQv9C+0LvRjNC30YPRjyDQs9C70YPQsdC+0LrQvtC1INC+0LHRg9GH0LXQvdC40LUgMzA0PGJyPjguNC4g0J7Qv9GA0LXQtNC10LvQuNGC0LUg0L/RgNC+0LHQtdC7INCyINC60L7QtNC1INGB0LrQvtC70YzQttC10L3QuNGPINC/0YDQvtCy0LXRgNC60LgsINC40YHQv9C+0LvRjNC30YPRjyDQs9C70YPQsdC+0LrQvtC1INC+0LHRg9GH0LXQvdC40LUgMzA5PGJyPjguNSDQmNGB0L/QvtC70YzQt9GD0LnRgtC1INC/0LvQsNGC0YTQvtGA0LzRgyDQutC+0LTQuNGA0L7QstCw0L3QuNGPINC00LvRjyDQvtC/0YDQtdC00LXQu9C10L3QuNGPINC60L7QtNC+0LIg0L/RgNC+0LLQtdGA0LrQuCAzMTY8YnI+OC42INCQ0LLRgtC+0LzQsNGC0LjRh9C10YHQutCw0Y8g0L7QsdGA0LDQsdC+0YLQutCwINC60L7QtNCwINC/0YDQvtCy0LXRgNC60Lgg0LzQvtCx0LjQu9GM0L3QvtCz0L4g0YLQtdC70LXRhNC+0L3QsCAzMjQ8YnI+0JPQu9Cw0LLQsCA5INCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INCw0LPQtdC90YLQsCAzMzE8YnI+OS4xINCd0LDRgdGC0YDQvtC50LrQuCDQv9GA0L7QutGB0LggMzMxPGJyPjkuMiDQotC10YXQvdC40YfQtdGB0LrQvtC1INC+0LHRgdC70YPQttC40LLQsNC90LjQtSDQv9GD0LvQsCDQsNCz0LXQvdGC0L7QsiAzNDA8YnI+OS4zINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INC/0LvQsNGC0L3Ri9GFINCw0LPQtdC90YLQvtCyIDM1MTxicj45LjQg0JrQsNC6INC/0L7RgdGC0YDQvtC40YLRjCBBRFNMIE5lbGVpbmcgQWdlbnQgMzU3PGJyPjkuNSDQpNCw0LrRgtC40YfQtdGB0LrQvtC1INC/0L7Qu9C30LDQvdC40LUg0LDQs9C10L3RgtGB0LrQuNGFINGB0LvRg9GH0LDQtdCyINC/0YDQvtGC0LjQstC+0LfQsNGH0LDRgtC+0YfQvdGL0YUg0YHQu9GD0YfQsNC10LIgMzY1PGJyPtCT0LvQsNCy0LAgMTAg0KHQuNC80YPQu9GP0YbQuNGPLiDQktGF0L7QtCAzNzM8YnI+MTAuMSDQntGB0L3QvtCy0L3Ri9C1INC/0YDQuNC90YbQuNC/0Ysg0LzQvtC00LXQu9C40YDRg9C10LzQvtCz0L4g0LLRhdC+0LTQsCAzNzM8YnI+MTAuMiDQodC80L7QtNC10LvQuNGA0L7QstCw0L3QvdCw0Y8g0L/QvtC70LfQsNC90LjQtSDQsiDQu9C+0LPQuNC9INC90LAg0L7RgdC90L7QstC1INGB0LXQsNC90YHQsCDQuCDRhNCw0LnQu9C+0LIgY29va2llIDM3Njxicj4xMC4zINCh0LzQvtC00LXQu9C40YDQvtCy0LDQvdC90LDRjyDQv9C+0LvQt9Cw0L3QuNC1INCyINC70L7Qs9C40L3QtSDQvdCwINC+0YHQvdC+0LLQtSBKV1QgMzgxPGJyPjEwLjQg0KHRgtGA0L7QuNGC0LXQu9GM0YHRgtCy0L4g0LrRgNGD0L/QvdC+0LzQsNGB0YjRgtCw0LHQvdC+0LPQviDQsdCw0YHRgdC10LnQvdCwIDM4NTxicj7Qk9C70LDQstCwIDExIEphdmFTY3JpcHQgUmV2ZXJzZSBDcmF3bGVyIDM5Nzxicj4xMS4xINCS0LLQtdC00LXQvdC40LUg0LIg0YLQtdGF0L3QvtC70L7Qs9C40Lgg0YjQuNGE0YDQvtCy0LDQvdC40Y8g0Lgg0LfQsNC/0YPRgtGL0LLQsNC90LjRjyDQstC10LEgLdGB0LDQudGC0L7QsiAzOTc8YnI+MTEuMiDQntCx0YnQuNC1INC80LXRgtC+0LTRiyDQvtGC0LvQsNC00LrQuCDQsdGA0LDRg9C30LXRgNC+0LIgNDEzPGJyPjExLjMg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUgSmF2YVNjcmlwdCBIb29rIDQzMDxicj4xMS40INCf0YDQuNC90YbQuNC/INC4INC+0LHRhdC+0LQg0LHQtdGB0LrQvtC90LXRh9C90L7Qs9C+INC+0YLQu9Cw0LTRh9C40LrQsCA0NDA8YnI+MTEuNSDQn9GA0L7RgNCw0LHQvtGC0LrQsCDQvNC+0LTQtdC70LjRgNC+0LLQsNC90LjRjyBKYXZhU2NyaXB0IDQ0NSDRgSBQeXRob248YnI+MTEuNiDQktGL0L/QvtC70L3QtdC90LjQtSDQvNC+0LTQtdC70LjRgNC+0LLQsNC90LjRjyDRgSBub2RlLmpzIDQ1MTxicj4xMS43INCS0YvQv9C+0LvQvdC10L3QuNC1INC80L7QtNC10LvQuNGA0L7QstCw0L3QuNGPIEphdmFTY3JpcHQg0LIg0YHRgNC10LTQtSDQsdGA0LDRg9C30LXRgNCwIDQ1NDxicj4xMS44IEFTVCBUZWNobm9sb2d5INCS0LLQtdC00LXQvdC40LUgNDYwPGJyPjExLjkg0JLQvtGB0YHRgtCw0L3QvtCy0LjRgtC1INC30LDQv9GD0YLRi9Cy0LDQtdC80YvQuSDQutC+0LQg0YEg0LjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LXQvCDRgtC10YXQvdC+0LvQvtCz0LjQuCBBU1QgNDcyPGJyPjExLjEwINCS0L7RgdGB0YLQsNC90L7QstC70LXQvdC40LUg0YHQv9C10YbQuNCw0LvRjNC90YvRhSDRgdC70YPRh9Cw0LXQsiDQt9Cw0L/Rg9GC0YvQstCw0L3QuNGPIDQ4MDxicj4xMS4xMSDQkNC90LDQu9C40Lcg0YHQu9GD0YfQsNC10LIg0LLQsNCz0L7QvdC+0LIg0Lgg0L/RgNCw0LrRgtC40YfQtdGB0LrQvtCz0L4g0L/QvtC70LrQuCA0OTA8YnI+MTEuMTIgSmF2YVNjcmlwdCDQvtCx0YDQsNGC0L3Ri9C1INC90LDQstGL0LrQuCDRgNC10LfRjtC80LUgNDk4PGJyPjExLjEzIEphdmFTY3JpcHQg0L7QsdGA0LDRgtC90YvQuSDQv9C+0LvQt9Cw0L3QuNC1IDUwNTxicj7Qk9C70LDQstCwIDEyINCU0LDQvdC90YvQtSDQv9GA0LjQu9C+0LbQtdC90LjRjyDQn9C+0LvQt9Cw0L3QuNC1IDUzMDxicj4xMi4xINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INC40L3RgdGC0YDRg9C80LXQvdGC0LAgQ2hhcmxlcyBQYWNrZXQgQ2F0Y2hpbmcgNTMwPGJyPjEyLjIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0L/QsNC60LXRgtCwIE1JVE1Qcm94eSBHcmFiYmVyIDUzODxicj4xMi4zIE1JIFVNUCDQsiDRgNC10LDQu9GM0L3QvtC8INCy0YDQtdC80LXQvdC4INC+0LHRgNCw0LHQvtGC0LrQsCDQv9Cw0LrQtdGC0L7QsiA1NDQ8YnI+MTIuNCDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSBBcHBpdW0gNTUxPGJyPjEyLjUg0J/RgNCw0LrRgtC40LrQsCDQv9C+0LvQt9Cw0L3QuNGPINC/0YDQuNC70L7QttC10L3QuNGPINC90LAg0L7RgdC90L7QstC1IEFwcGl1bSA1NjI8YnI+MTIuNiDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSBBaXJ0ZXN0IDU2ODxicj4xMi43INCf0L7Qu9C30LDQvdC40LUg0L/RgNC40LvQvtC20LXQvdC40Y8g0L3QsCDQvtGB0L3QvtCy0LUgQWlydGVzdCA1ODU8YnI+MTIuOCDQo9C/0YDQsNCy0LvQtdC90LjQtSDQs9GA0YPQv9C/0L7QuSDQvNC+0LHQuNC70YzQvdGL0YUg0YLQtdC70LXRhNC+0L3QvtCyINCf0YDQsNC60YLQuNC60LAg0L/QvtC70LfQsNC90LjRjyA1OTE8YnI+MTIuOSDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSDQvtCx0LvQsNGH0L3Ri9GFINC80L7QsdC40LvRjNC90YvRhSDRgtC10LvQtdGE0L7QvdC+0LIgNTk0PGJyPtCT0LvQsNCy0LAgMTMgQW5kcm9pZCBSZXZlcnNlIDYwMzxicj4xMy4xINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IEpBRFggNjAzPGJyPjEzLjIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUgSkVCIDYxNTxicj4xMy4zINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IHhwb3NlZCBmcmFtZXdvcmsgNjI0PGJyPjEzLjQg0J/RgNCw0LrRgtC40YfQtdGB0LrQuNC1INGB0LvRg9GH0LDQuCDQv9C+0LvQt9Cw0L3QuNGPINC90LAg0L7RgdC90L7QstC1IFhwb3NlZCA2MzU8YnI+MTMuNSBGcmlkYSBVc2UgNjQzPGJyPjEzLjYgU1NMIFBlbmRpbmcg0J/RgNC+0LHQu9C10LzQsCDQoNC10YjQtdC90LjQtSA2NTA8YnI+MTMuNyDQktCS0JXQlNCV0J3QmNCVINCYINCf0KDQkNCa0KLQmNCn0JXQodCa0JjQmSDQkdCe0KDQrNCvINCi0JXQpdCd0J7Qm9Ce0JPQmNCYINCj0JTQkNCb0JXQndCY0K8gQU5EUk9JRCBTSEVMTEUgNjU3PGJyPjEzLjgg0JjQodCf0J7Qm9Cs0JfQntCS0JDQndCY0JUgSURBIFBSTyDQodGC0LDRgtC40YfQtdGB0LrQuNC5INCw0L3QsNC70LjQtyDQuCDQtNC40L3QsNC80LjRh9C10YHQutCw0Y8g0L7RgtC70LDQtNC60LAsINC/0L7RjdGC0L7QvNGDINGE0LDQudC70YsgNjY0PGJyPjEzLjkg0J/RgNC+0LLQtdGA0LrQsCDQvNC+0LTQtdC70LjRgNC+0LLQsNC90LjRjywg0L/QvtGN0YLQvtC80YMg0YTQsNC50Lsg0L3QsCDQvtGB0L3QvtCy0LUgRlJJREEtUlBDIDY4MDxicj4xMy4xMCDQktGL0L/QvtC70L3QtdC90LjQtSDQvNC+0LTQtdC70LjRgNC+0LLQsNC90LjRjywg0L/QvtGN0YLQvtC80YMg0YTQsNC50Lsg0L3QsCDQvtGB0L3QvtCy0LUg0LggU2VydmVyLVJQQyA2ODU8YnI+MTMuMTEg0J/RgNC+0YDQsNCx0L7RgtC60LAg0LzQvtC00LXQu9C40YDQvtCy0LDQvdC40Y8sINC/0L7RjdGC0L7QvNGDINGE0LDQudC7INC90LAg0L7RgdC90L7QstC1IFVuaWRiZyA2OTI8YnI+0JPQu9Cw0LLQsCAxNCDQodGC0YDQsNC90LjRhtCwINC40L3RgtC10LvQu9C10LrRgtGD0LDQu9GM0L3QvtCz0L4g0LDQvdCw0LvQuNC30LAgNzAwPGJyPjE0LjEg0JLQstC10LTQtdC90LjQtSDQsiBQYWdlIEludGVsbGlnZW50IEFuYWx5c2lzIDcwMDxicj4xNC4yINCS0LLQtdC00LXQvdC40LUg0LIg0LDQu9Cz0L7RgNC40YLQvCDQuNC90YLQtdC70LvQtdC60YLRg9Cw0LvRjNC90L7Qs9C+INCw0L3QsNC70LjQt9CwINC00LXRgtCw0LvQtdC5INCh0YLRgNCw0L3QuNGG0LAgNzA3PGJyPjE0LjMg0KDQtdCw0LvQuNC30LDRhtC40Y8g0LDQu9Cz0L7RgNC40YLQvNCwINC40L3RgtC10LvQu9C10LrRgtGD0LDQu9GM0L3QvtCz0L4g0LDQvdCw0LvQuNC30LAg0L3QsCDQtNC10YLQsNC70Y/RhSDRgdGC0YDQsNC90LjRhtGLIDcxNDxicj4xNC40INCS0LLQtdC00LXQvdC40LUg0LIg0LDQu9Cz0L7RgNC40YLQvCDQuNC90YLQtdC70LvQtdC60YLRg9Cw0LvRjNC90L7Qs9C+INCw0L3QsNC70LjQt9CwINC00LvRjyDRgdGC0YDQsNC90LjRhiDRgdC/0LjRgdC60L7QsiA3MjI8YnI+MTQuNSDQoNC10LDQu9C40LfQsNGG0LjRjyDQsNC70LPQvtGA0LjRgtC80LAg0LjQvdGC0LXQu9C70LXQutGC0YPQsNC70YzQvdC+0LPQviDQsNC90LDQu9C40LfQsCDQsiDRgdC/0LjRgdC60LUg0YHRgtGA0LDQvdC40YbRiyA3Mjc8YnI+MTQuNiDQmtCw0Log0YDQsNC30YPQvNC90L4g0YDQsNC30LvQuNGH0LjRgtGMINC70LjRgdGC0LjRh9C10YHQutC40LUg0YHRgtGA0LDQvdC40YbRiyDQuCDQtNC10YLQsNC70Lgg0YHRgtGA0LDQvdC40YYgNzM1PGJyPtCT0LvQsNCy0LAgMTUg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0YHRgtGA0YPQutGC0YPRgNGLINGB0LrRgNC10YnQuNCy0LDQvdC40Y8gNzM5PGJyPjE1LjEg0JLQstC10LTQtdC90LjQtSDQsiDRgdGC0YDRg9C60YLRg9GA0YMg0YHQutGA0LXRidC40LLQsNC90LjRjyA3Mzk8YnI+MTUuMiDQndCw0YfQsNC70L4g0YDQsNCx0L7RgtGLINGBIFNjcmFweSA3NDM8YnI+MTUuMyDQmNGB0L/QvtC70YzQt9C+0LLQsNC90LjQtSDRgdC10LvQtdC60YLQvtGA0LAgNzU0PGJyPjE1LjQg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0L/QsNGD0LrQvtCyIDc1OTxicj4xNS41INCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INC/0YDQvtC80LXQttGD0YLQvtGH0L3QvtCz0L4g0L/RgNC+0LPRgNCw0LzQvNC90L7Qs9C+INC+0LHQtdGB0L/QtdGH0LXQvdC40Y8g0LTQu9GPINC30LDQs9GA0YPQt9C60LggNzY2PGJyPjE1LjYg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0L/RgNC+0LzQtdC20YPRgtC+0YfQvdC+0LPQviDQv9GA0L7Qs9GA0LDQvNC80L3QvtCz0L4g0L7QsdC10YHQv9C10YfQtdC90LjRjyBTcGlkZXIgNzc1PGJyPjE1Ljcg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0Y3Qu9C10LzQtdC90YLQsNGA0L3QvtCz0L4g0YLRgNGD0LHQvtC/0YDQvtCy0L7QtNCwIDc4MTxicj4xNS44INCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1INGA0LDRgdGI0LjRgNC10L3QuNGPIDc5Mjxicj4xNS45INCh0LrQutGA0LDRgSAt0YHQvtC10LTQuNC90LXQvdC40LUgU2VsZW5pdW0gNzk1PGJyPjE1LjEwINCh0LrRgNC10LnQutCwINGB0YLRi9C60L7QstC60LggU3BsYXNoIDgwMTxicj4xNS4xMSDQodC60YDRgNCw0L/QuNGPINGB0YLRi9C60L7QstC60LggUHlwcGV0ZWVyIDgwNjxicj4xNS4xMiBTY3JhcHkg0YDQtdCz0YPQu9GP0YLQvtGAIENyYXdsZXIgODEzPGJyPjE1LjEzINCf0YDQsNC60YLQuNC60LAg0YHQutGA0LDRgdC60LggODI3PGJyPtCT0LvQsNCy0LAgMTYg0KDQsNGB0L/RgNC10LTQtdC70LXQvdC90YvQtSDQs9GD0YHQtdC90LjRhtGLIDg0MDxicj4xNi4xINCg0LDRgdC/0YDQtdC00LXQu9C10L3QvdCw0Y8g0LrQvtC90YbQtdC/0YbQuNGPIENyYXdsZXIgODQwPGJyPjE2LjIg0J/RgNC40L3RhtC40L8gU2NyYXB5LVJlZGlzINC4INCw0L3QsNC70LjQtyDQuNGB0YXQvtC00L3QvtCz0L4g0LrQvtC00LAgODQyPGJyPjE2LjMg0KDQsNGB0L/RgNC10LTQtdC70LXQvdC90LDRjyDRgNC10LDQu9C40LfQsNGG0LjRjyBDcmF3bGVyINC90LAg0L7RgdC90L7QstC1IFNjcmFweS1SZWRpcyA4NDc8YnI+MTYuNCDQutGA0YPQv9C90L7QvNCw0YHRiNGC0LDQsdC90LDRjyDQtNC10LTRg9C/0LvQuNC60LDRhtC40Y8g0L3QsCDQvtGB0L3QvtCy0LUg0YTQuNC70YzRgtGA0LAgQmxvb20gODUxPGJyPjE2LjUg0KDQsNGB0L/RgNC10LTQtdC70LXQvdC90YvQtSDQs9GD0YHQtdC90LjRhtGLINC90LAg0L7RgdC90L7QstC1IFJhYmJpdG1xIDg1OTxicj7Qk9C70LDQstCwIDE3INCj0L/RgNCw0LLQu9C10L3QuNC1INC4INGA0LDQt9Cy0LXRgNGC0YvQstCw0L3QuNC1IENyYXdsZXJzIDg2Mjxicj4xNy4xINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IFNjcmFweWQg0LggU2NyYXB5ZCBBUEkgODYyPGJyPjE3LjIg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUgU2NyYXB5ZC1DbGllbnQgODY3PGJyPjE3LjMg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUg0YDQsNC80LrQuCDRg9C/0YDQsNCy0LvQtdC90LjRjyDQk9C10YDQsNC/0LXRgNC+0LwgQ3Jhd2xlciA4Njk8YnI+MTcuNCDQo9C/0LDQutC+0LLQutCwINC/0YDQvtC10LrRgtCwINGB0LrRgNCw0YHQutC4INCyINC40LfQvtCx0YDQsNC20LXQvdC40LUgRG9ja2VyIDg3Mzxicj4xNy41IERvY2tlciBDb21wb3NlINCY0YHQv9C+0LvRjNC30L7QstCw0L3QuNC1IDg3ODxicj4xNy42IEt1YmVybmV0ZXMg0JjRgdC/0L7Qu9GM0LfQvtCy0LDQvdC40LUgODgwPGJyPjE3Ljcg0KDQsNC30LLQtdGA0YLRi9Cy0LDQvdC40LUg0Lgg0YPQv9GA0LDQstC70LXQvdC40LUg0YHQutGA0LXRidC40L3QsNC80Lgg0YEgS3ViZXJuZXRlcyA4ODg8YnI+MTcuOCDQodGF0LXQvNCwINGB0YLQsNGC0LjRgdGC0LjQutC4INC00LDQvdC90YvRhSDQtNC70Y8g0YDQsNGB0L/RgNC10LTQtdC70LXQvdC90YvRhSDRgdC60LDQvdC10YDQvtCyIFNjcmFweSA4OTk8YnI+MTcuOSDQodGF0LXQvNCwINC80L7QvdC40YLQvtGA0LjQvdCz0LAg0YDQsNGB0L/RgNC10LTQtdC70LXQvdC90L7Qs9C+INGF0YDRg9C/0LrQsCDQvdCwINC+0YHQvdC+0LLQtSDQn9GA0L7QvNC10YLQtdGPINC4INCT0YDQsNGE0LDQvdCwIDkwNDxicj7Qn9GA0LjQu9C+0LbQtdC90LjQtSBDcmF3bGVycyBhbmQgTGF3cyA5MTc8cD4uLi4uLi48L3A+PC9kaXY+PC9kaXY+PGltZyBjbGFzcz0iZGVzY19hbmNob3IiIGlkPSJkZXNjLW1vZHVsZS01IiBzcmM9Imh0dHA6Ly9hc3NldHMuYWxpY2RuLmNvbS9raXNzeS8xLjAuMC9idWlsZC9pbWdsYXp5bG9hZC9zcGFjZWJhbGwuZ2lmIj48ZGl2PjxkaXY+0KbQstC10YIg0YHRgtGA0LDQvdC40YbQsDo8L2Rpdj48ZGl2PiAgICAgICZuYnNwOyAgICAgPC9kaXY+PC9kaXY+PHA+Jm5ic3A7PC9wPjxpbWcgc3JjPSJodHRwczovL3d3dy5vMGIuY24vaS5waHA/dC5wbmcmcmlkPWd3LTMuNjVkMjNkYThiMDllYyZwPTM1ODU1NTMzNjkmaz1lLmNvbSZ0PTE3MDgyNzcxNjUiIHN0eWxlPSJkaXNwbGF5Om5vbmUiPg==

Продавец:天猫超市

Рейтинг:

Всего отзывов:0

Положительных:0

Добавить в корзину

- Информация о товаре

- Фотографии

Основная информация

| наименование товара: | Python3 Network Crawler Development Faction Bight № 2 издание | формат: | 16 |

| Автор: | Cui Qingcai | Количество страниц: | |

| Цены: | 139.8 | Опубликованная дата: | 2021-11-01 |

| Номер ISBN: | 9787115577092 | Время печати: | 2021-11-01 |

| Издательство: | Народные сообщения и телекоммуникации | Версия: | 2 |

| Типы продукта: | книги | Индийский: | 2 |

Об авторе:

Cui Qingcai - инженер -программист в Microsoft (China), степень магистра в Пекинском университете аэронавтики и астронавтики, в основном изучая веб -сканеров, веб -разработку, машинное обучение и другие направления.

Краткое содержание:

В этой книге описывается, как разработать веб -сканеры с помощью Python 3. Эта книга является вторым изданием.По сравнению с первым изданием, он оснащен целенаправленными учебными станциями для практических проектов каждой точки знания, избегая проблемы истечения срока действия.Кроме того, знания, такие как асинхронные сканеры, JavaScript Reverse, App Reverse, интеллектуальный анализ страниц, код проверки распознавания глубокого обучения, были добавлены эксплуатация и техническое обслуживание и развертывание Kubernetes.В то же время, такие инструменты, как запрос, хранение, анализ и тестирование, связанные с каждой точкой знаний, были обогащены и новыми.

Эта книга подходит для программистов Python для чтения.

Эта книга подходит для программистов Python для чтения.

......

Оглавление:

Глава 1 Основы гусеницы 1

1.1 http Basic Principle 1

1.2 Основы веб -страницы 12

1.3 Основные принципы Crawlers 19

1,4 сеанса и куки 21

1.5 Основные принципы агента 24

1.6 Основные принципы многопоточного и многопроцесса 26

Глава 2 Использование базовой библиотеки 29

2.1 Использование Urllib 29

2.2 Использование запросов 47

2.3 Регулярное выражение 63

2.4 Использование HTTPX 73

2.5 Основная практика корпуса Crawler 78

Глава 3 Анализ и извлечение данных веб -страницы 90

3.1 xpath Использование 90

3.2 Использование красивого супа 99

3.3 Использование Pyquery 113

3.4 Использование Парселя 124

Глава 4 Хранение данных 128

4.1 TXT Text File Storage 128

4.2 JSON File Storage 130

4.3 CSV File Storage 134

4.4 MySQL Storage 138

4.5 хранилище документов MongoDB 144

4.6 Redis Cache Storage 151

4.7 Elasticsearch Search Engine Storage 159

4.8 Использование Rabbitmq 166

Глава 5 Ajax Data Clawling 174

5.1 Что такое Ajax 174

5.2 Метод анализа AJAX 176

5.3 Ajax Analysis and Clawling Practice 179

Глава 6 Асинхронный гусеница 191

6.1 Основные принципы Coroutines 191

6.2 Использование AIOHTTP 201

6.3 AIOHTTP Асинхронная практика ползания 207

Глава 7 Страница динамического рендеринга JavaScript 212

7.1 Использование селена 212

7.2 Использование Splash 226

7.3 Использование Pyppeteer 242

7.4 Использование драматурга 257

7.5 Selenium Practicking 269

7.6 Pyppeteer Clawling Practice 276

7.7 CSS Position Offset Anti-Climbing Case Analysis и Practice 282

7.8 АНАЛИЗ АНТИ-КЛИМСИНГОВОГО АНАЛИЗА И ПРАКТИЧЕСКИЙ КЛАЗОВЫЙ РАСПРАВЛЕНИЕ 287

Глава 8 Идентификация кода проверки 293

8.1. Определите графические коды проверки с использованием технологии OCR 293

8.2 Используйте OpenCV, чтобы определить пробелы в кодах скольжения. 298

8.3. Определите коды проверки графика, используя глубокое обучение 304

8.4. Определите пробел в коде скольжения проверки, используя глубокое обучение 309

8.5 Используйте платформу кодирования для определения кодов проверки 316

8.6 Автоматическая обработка кода проверки мобильного телефона 324

Глава 9 Использование агента 331

9.1 Настройки прокси 331

9.2 Техническое обслуживание пула агентов 340

9.3 Использование платных агентов 351

9.4 Как построить ADSL Neleing Agent 357

9.5 Фактическое ползание агентских случаев противозачаточных случаев 365

Глава 10 Симуляция. Вход 373

10.1 Основные принципы моделируемого входа 373

10.2 Смоделированная ползание в логин на основе сеанса и файлов cookie 376

10.3 Смоделированная ползание в логине на основе JWT 381

10.4 Строительство крупномасштабного бассейна 385

Глава 11 JavaScript Reverse Crawler 397

11.1 Введение в технологии шифрования и запутывания веб -сайтов 397

11.2 Общие методы отладки браузеров 413

11.3 Использование JavaScript Hook 430

11.4 Принцип и обход бесконечного отладчика 440

11.5 Проработка моделирования JavaScript 445 с Python

11.6 Выполнение моделирования с node.js 451

11.7 Выполнение моделирования JavaScript в среде браузера 454

11.8 AST Technology Введение 460

11.9 Восстановите запутываемый код с использованием технологии AST 472

11.10 Восстановление специальных случаев запутывания 480

11.11 Анализ случаев вагонов и практического полки 490

11.12 JavaScript обратные навыки резюме 498

11.13 JavaScript обратный ползание 505

Глава 12 Данные приложения Ползание 530

12.1 Использование инструмента Charles Packet Catching 530

12.2 Использование пакета MITMProxy Grabber 538

12.3 MI UMP в реальном времени обработка пакетов 544

12.4 Использование Appium 551

12.5 Практика ползания приложения на основе Appium 562

12.6 Использование Airtest 568

12.7 Ползание приложения на основе Airtest 585

12.8 Управление группой мобильных телефонов Практика ползания 591

12.9 Использование облачных мобильных телефонов 594

Глава 13 Android Reverse 603

13.1 Использование JADX 603

13.2 Использование JEB 615

13.3 Использование xposed framework 624

13.4 Практические случаи ползания на основе Xposed 635

13.5 Frida Use 643

13.6 SSL Pending Проблема Решение 650

13.7 ВВЕДЕНИЕ И ПРАКТИЧЕСКИЙ БОРЬЯ ТЕХНОЛОГИИ УДАЛЕНИЯ ANDROID SHELLE 657

13.8 ИСПОЛЬЗОВАНИЕ IDA PRO Статический анализ и динамическая отладка, поэтому файлы 664

13.9 Проверка моделирования, поэтому файл на основе FRIDA-RPC 680

13.10 Выполнение моделирования, поэтому файл на основе и Server-RPC 685

13.11 Проработка моделирования, поэтому файл на основе Unidbg 692

Глава 14 Страница интеллектуального анализа 700

14.1 Введение в Page Intelligent Analysis 700

14.2 Введение в алгоритм интеллектуального анализа деталей Страница 707

14.3 Реализация алгоритма интеллектуального анализа на деталях страницы 714

14.4 Введение в алгоритм интеллектуального анализа для страниц списков 722

14.5 Реализация алгоритма интеллектуального анализа в списке страницы 727

14.6 Как разумно различить листические страницы и детали страниц 735

Глава 15 Использование структуры скрещивания 739

15.1 Введение в структуру скрещивания 739

15.2 Начало работы с Scrapy 743

15.3 Использование селектора 754

15.4 Использование пауков 759

15.5 Использование промежуточного программного обеспечения для загрузки 766

15.6 Использование промежуточного программного обеспечения Spider 775

15.7 Использование элементарного трубопровода 781

15.8 Использование расширения 792

15.9 Сккрас -соединение Selenium 795

15.10 Скрейка стыковки Splash 801

15.11 Скррапия стыковки Pyppeteer 806

15.12 Scrapy регулятор Crawler 813

15.13 Практика скраски 827

Глава 16 Распределенные гусеницы 840

16.1 Распределенная концепция Crawler 840

16.2 Принцип Scrapy-Redis и анализ исходного кода 842

16.3 Распределенная реализация Crawler на основе Scrapy-Redis 847

16.4 крупномасштабная дедупликация на основе фильтра Bloom 851

16.5 Распределенные гусеницы на основе Rabbitmq 859

Глава 17 Управление и развертывание Crawlers 862

17.1 Использование Scrapyd и Scrapyd API 862

17.2 Использование Scrapyd-Client 867

17.3 Использование рамки управления Герапером Crawler 869

17.4 Упаковка проекта скраски в изображение Docker 873

17.5 Docker Compose Использование 878

17.6 Kubernetes Использование 880

17.7 Развертывание и управление скрещинами с Kubernetes 888

17.8 Схема статистики данных для распределенных сканеров Scrapy 899

17.9 Схема мониторинга распределенного хрупка на основе Прометея и Графана 904

Приложение Crawlers and Laws 917

1.1 http Basic Principle 1

1.2 Основы веб -страницы 12

1.3 Основные принципы Crawlers 19

1,4 сеанса и куки 21

1.5 Основные принципы агента 24

1.6 Основные принципы многопоточного и многопроцесса 26

Глава 2 Использование базовой библиотеки 29

2.1 Использование Urllib 29

2.2 Использование запросов 47

2.3 Регулярное выражение 63

2.4 Использование HTTPX 73

2.5 Основная практика корпуса Crawler 78

Глава 3 Анализ и извлечение данных веб -страницы 90

3.1 xpath Использование 90

3.2 Использование красивого супа 99

3.3 Использование Pyquery 113

3.4 Использование Парселя 124

Глава 4 Хранение данных 128

4.1 TXT Text File Storage 128

4.2 JSON File Storage 130

4.3 CSV File Storage 134

4.4 MySQL Storage 138

4.5 хранилище документов MongoDB 144

4.6 Redis Cache Storage 151

4.7 Elasticsearch Search Engine Storage 159

4.8 Использование Rabbitmq 166

Глава 5 Ajax Data Clawling 174

5.1 Что такое Ajax 174

5.2 Метод анализа AJAX 176

5.3 Ajax Analysis and Clawling Practice 179

Глава 6 Асинхронный гусеница 191

6.1 Основные принципы Coroutines 191

6.2 Использование AIOHTTP 201

6.3 AIOHTTP Асинхронная практика ползания 207

Глава 7 Страница динамического рендеринга JavaScript 212

7.1 Использование селена 212

7.2 Использование Splash 226

7.3 Использование Pyppeteer 242

7.4 Использование драматурга 257

7.5 Selenium Practicking 269

7.6 Pyppeteer Clawling Practice 276

7.7 CSS Position Offset Anti-Climbing Case Analysis и Practice 282

7.8 АНАЛИЗ АНТИ-КЛИМСИНГОВОГО АНАЛИЗА И ПРАКТИЧЕСКИЙ КЛАЗОВЫЙ РАСПРАВЛЕНИЕ 287

Глава 8 Идентификация кода проверки 293

8.1. Определите графические коды проверки с использованием технологии OCR 293

8.2 Используйте OpenCV, чтобы определить пробелы в кодах скольжения. 298

8.3. Определите коды проверки графика, используя глубокое обучение 304

8.4. Определите пробел в коде скольжения проверки, используя глубокое обучение 309

8.5 Используйте платформу кодирования для определения кодов проверки 316

8.6 Автоматическая обработка кода проверки мобильного телефона 324

Глава 9 Использование агента 331

9.1 Настройки прокси 331

9.2 Техническое обслуживание пула агентов 340

9.3 Использование платных агентов 351

9.4 Как построить ADSL Neleing Agent 357

9.5 Фактическое ползание агентских случаев противозачаточных случаев 365

Глава 10 Симуляция. Вход 373

10.1 Основные принципы моделируемого входа 373

10.2 Смоделированная ползание в логин на основе сеанса и файлов cookie 376

10.3 Смоделированная ползание в логине на основе JWT 381

10.4 Строительство крупномасштабного бассейна 385

Глава 11 JavaScript Reverse Crawler 397

11.1 Введение в технологии шифрования и запутывания веб -сайтов 397

11.2 Общие методы отладки браузеров 413

11.3 Использование JavaScript Hook 430

11.4 Принцип и обход бесконечного отладчика 440

11.5 Проработка моделирования JavaScript 445 с Python

11.6 Выполнение моделирования с node.js 451

11.7 Выполнение моделирования JavaScript в среде браузера 454

11.8 AST Technology Введение 460

11.9 Восстановите запутываемый код с использованием технологии AST 472

11.10 Восстановление специальных случаев запутывания 480

11.11 Анализ случаев вагонов и практического полки 490

11.12 JavaScript обратные навыки резюме 498

11.13 JavaScript обратный ползание 505

Глава 12 Данные приложения Ползание 530

12.1 Использование инструмента Charles Packet Catching 530

12.2 Использование пакета MITMProxy Grabber 538

12.3 MI UMP в реальном времени обработка пакетов 544

12.4 Использование Appium 551

12.5 Практика ползания приложения на основе Appium 562

12.6 Использование Airtest 568

12.7 Ползание приложения на основе Airtest 585

12.8 Управление группой мобильных телефонов Практика ползания 591

12.9 Использование облачных мобильных телефонов 594

Глава 13 Android Reverse 603

13.1 Использование JADX 603

13.2 Использование JEB 615

13.3 Использование xposed framework 624

13.4 Практические случаи ползания на основе Xposed 635

13.5 Frida Use 643

13.6 SSL Pending Проблема Решение 650

13.7 ВВЕДЕНИЕ И ПРАКТИЧЕСКИЙ БОРЬЯ ТЕХНОЛОГИИ УДАЛЕНИЯ ANDROID SHELLE 657

13.8 ИСПОЛЬЗОВАНИЕ IDA PRO Статический анализ и динамическая отладка, поэтому файлы 664

13.9 Проверка моделирования, поэтому файл на основе FRIDA-RPC 680

13.10 Выполнение моделирования, поэтому файл на основе и Server-RPC 685

13.11 Проработка моделирования, поэтому файл на основе Unidbg 692

Глава 14 Страница интеллектуального анализа 700

14.1 Введение в Page Intelligent Analysis 700

14.2 Введение в алгоритм интеллектуального анализа деталей Страница 707

14.3 Реализация алгоритма интеллектуального анализа на деталях страницы 714

14.4 Введение в алгоритм интеллектуального анализа для страниц списков 722

14.5 Реализация алгоритма интеллектуального анализа в списке страницы 727

14.6 Как разумно различить листические страницы и детали страниц 735

Глава 15 Использование структуры скрещивания 739

15.1 Введение в структуру скрещивания 739

15.2 Начало работы с Scrapy 743

15.3 Использование селектора 754

15.4 Использование пауков 759

15.5 Использование промежуточного программного обеспечения для загрузки 766

15.6 Использование промежуточного программного обеспечения Spider 775

15.7 Использование элементарного трубопровода 781

15.8 Использование расширения 792

15.9 Сккрас -соединение Selenium 795

15.10 Скрейка стыковки Splash 801

15.11 Скррапия стыковки Pyppeteer 806

15.12 Scrapy регулятор Crawler 813

15.13 Практика скраски 827

Глава 16 Распределенные гусеницы 840

16.1 Распределенная концепция Crawler 840

16.2 Принцип Scrapy-Redis и анализ исходного кода 842

16.3 Распределенная реализация Crawler на основе Scrapy-Redis 847

16.4 крупномасштабная дедупликация на основе фильтра Bloom 851

16.5 Распределенные гусеницы на основе Rabbitmq 859

Глава 17 Управление и развертывание Crawlers 862

17.1 Использование Scrapyd и Scrapyd API 862

17.2 Использование Scrapyd-Client 867

17.3 Использование рамки управления Герапером Crawler 869

17.4 Упаковка проекта скраски в изображение Docker 873

17.5 Docker Compose Использование 878

17.6 Kubernetes Использование 880

17.7 Развертывание и управление скрещинами с Kubernetes 888

17.8 Схема статистики данных для распределенных сканеров Scrapy 899

17.9 Схема мониторинга распределенного хрупка на основе Прометея и Графана 904

Приложение Crawlers and Laws 917

......

Цвет страница: